PR

AIが出す答えは、なぜいつも「どこかで読んだような内容」なのか

AIに文章を書かせると、なぜか毎回似たような仕上がりになる。そう感じたことはないだろうか。

「AIを活用することで業務効率が向上します」「まずは目標を明確にすることが大切です」——読んだ瞬間に「あ、これどこかで見た」と感じる文章。間違ってはいない。でも、誰の心にも刺さらない。

これはAIの「頭が悪い」せいではない。むしろ逆だ。AIは膨大なテキストデータから「最も無難で正解率の高い回答」を統計的に選び出すように設計されている。つまり、一般論を出力することがAIにとっての「正解」なのだ。

問題は、コンテンツクリエイターが求めているのは「正解」ではなく「刺さる視点」だという点にある。

一般論とは何か——AIが「安全な回答」を選ぶ理由

一般論とは、多くの人が「そうだよね」と頷ける、反論されにくい内容のことだ。

AIは学習データの中から「最も多くの文脈で支持されている表現」を優先して出力する。これは技術的に合理的な設計だが、コンテンツ制作の文脈では致命的な欠陥になる。

なぜなら、読者が記事を読む理由は「知らなかったことを知るため」か「自分の感覚を言語化してもらうため」だからだ。どこかで読んだことのある内容を、もう一度読む理由はない。

AIが「安全な回答」を選ぶのは、リスクを取るよう指示されていないからだ。誰も「尖った意見を出せ」と明示的に要求しなければ、AIは永遠に平均点の回答を出し続ける。

「それっぽいけど使えない」コンテンツが生まれる構造的な問題

AIが生成する文章の多くは、構造は整っているが、読後感がゼロという特徴を持つ。

見出しはある。段落もある。結論もある。でも読み終わったあと、何も残らない。これは「情報としては正しいが、インサイトがない」状態だ。

インサイトとは、読者が「そうか、そういうことか!」と膝を打つ瞬間を生む視点のことだ。それは統計的な平均値からは生まれない。平均から外れた、少し偏った、でも本質を突いた角度からしか生まれない。

AIにその角度を出させるには、意図的に「平均から外れる方向」へ押し込む圧力が必要だ。その圧力をかけるのが、ダメ出しプロンプトという技術である。

AIを「壁打ち相手」ではなく「思考の砥石」として使う

多くの人がAIを「壁打ち相手」として使っている。アイデアを投げて、返ってきたものをそのまま使う。あるいは少し手を加えて完成とする。

しかしこのアプローチでは、AIが出す「最初の回答」の品質がそのままコンテンツの品質の上限になってしまう。

AIを「思考の砥石」として使うとはどういうことか。砥石は刃物を研ぐ道具だ。砥石自体が切れ味を持つわけではない。刃を何度も押し当て、削り続けることで、はじめて切れ味が生まれる。

AIも同じだ。最初の回答は「荒削りの刃」に過ぎない。それを叩き、削り、研ぎ続けることで、やっと使えるインサイトが姿を現す。その研ぐ作業こそが「ダメ出し」だ。

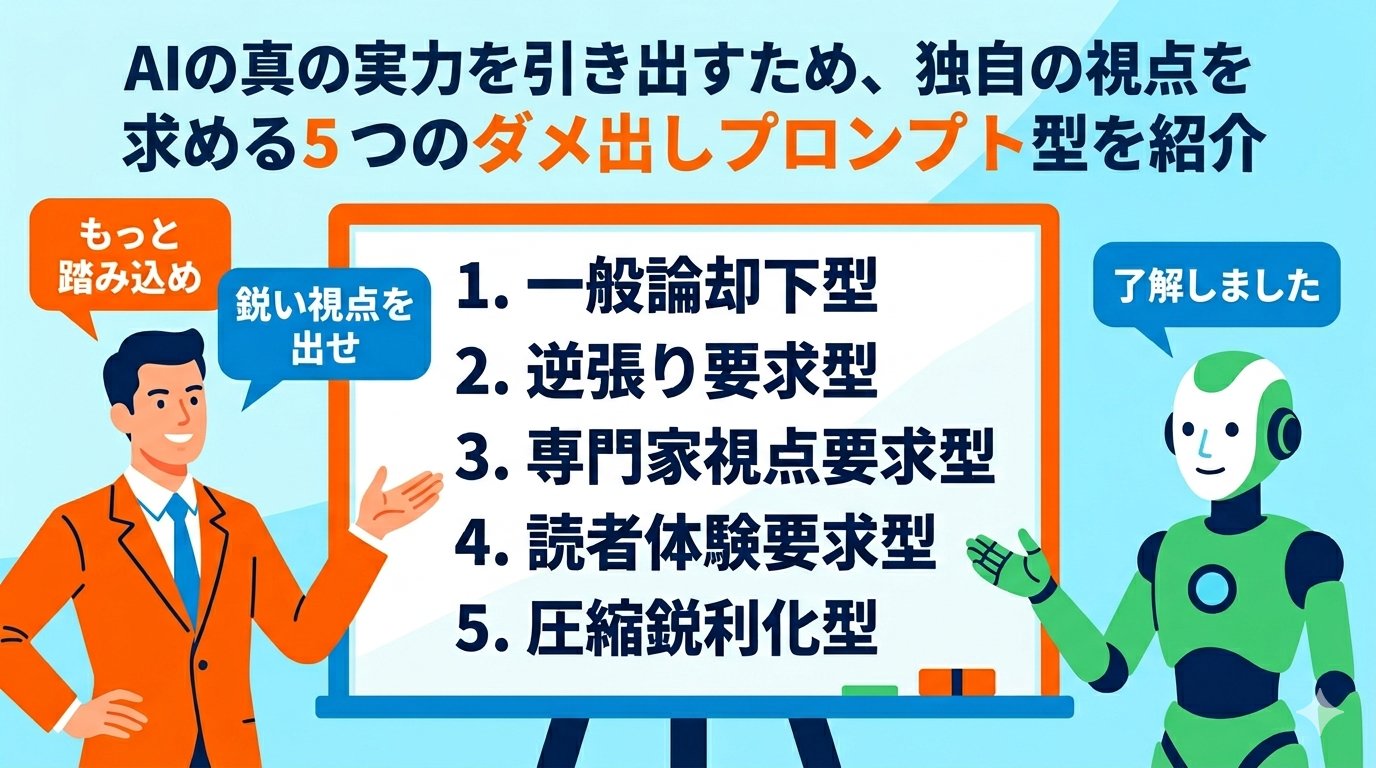

ダメ出しプロンプトの具体的な型——「それは一般論だ、もっと踏み込め」

では実際に、どのようなプロンプトでAIに圧力をかけるのか。以下に具体的な型を示す。

【型①:一般論却下型】

「今の回答は一般論だ。ほとんどのブログやビジネス書に書いてある内容と変わらない。もっと具体的に、もっと踏み込んだ視点で書き直せ」

【型②:逆張り要求型】

「今の回答の逆の立場から論じるとどうなるか。あえて反論してみせろ」

【型③:専門家視点要求型】

「この分野の第一人者が読んだとき、『そこまで言うか』と思うような踏み込んだ見解を出せ」

【型④:読者体験要求型】

「この文章を読んだ人が『そうか、だからそうなのか!』と膝を打つような、因果関係の説明を加えろ」

【型⑤:圧縮鋭利化型】

「今の内容を半分の文字数で、インパクトを2倍にして書き直せ。削れる一般論はすべて削れ」

これらの型は単発で使うのではなく、AIが「十分に鋭い」と自分が判断できるまで、繰り返し組み合わせて使うことが重要だ。

何度却下しても折れない——圧力をかけ続けるループ戦略

ダメ出しを1回すれば解決する、と思っていると失敗する。

AIは1回ダメ出しされても、次の回答でまた別の「安全な表現」を選ぶことがある。ダメ出しループとは、満足できるまで何度でも却下し続けるプロセスのことだ。

具体的なループの回し方はこうだ。

まず、AIに最初の回答を出させる。次に、「この回答のどこが一般論か」を自分で言語化する。そしてその言語化をそのままプロンプトにぶつける。返ってきた回答をまた評価する。これを繰り返す。

重要なのは、「なんか違う」という感覚を言語化する訓練だ。「なんか違う」のままではプロンプトに変換できない。「どこが一般論なのか」「何が足りないのか」「どの方向に踏み込んでほしいのか」を言葉にする力が、ダメ出しの精度を決める。

AIの品質はプロンプトの品質で決まる。そしてプロンプトの品質は、あなたの「言語化力」で決まる。

eddie’s Advice:AIは「深さ」を求められるまで、絶対に深くならない

AIに「いい感じに書いて」と頼んでいる限り、AIは永遠にいい感じの一般論を出し続ける。AIは深さを「自発的に」追求しない。深さとは、要求されてはじめて出てくるものだ。

これはAIの限界ではなく、使い手の問題だ。深い問いを持っている人間だけが、AIから深い答えを引き出せる。

逆に言えば、あなたがダメ出しを重ねるほど、AIはあなたの思考の解像度に引き上げられていく。AIを鍛えているのではない。AIとの対話を通じて、あなた自身の思考が研ぎ澄まされているのだ。

ダメ出し力とは、批判力ではなく、「もっとよくなるはずだ」という確信を持ち続ける力だ。

結論:鋭いインサイトは、AIではなく「あなたのダメ出し力」が生み出す

AIは道具だ。どんなに優秀な道具でも、使い手の意図と技術がなければ、その力を引き出すことはできない。

AIが出す最初の回答を「素材」と捉えること。そしてその素材を、ダメ出しというプロセスで削り込んでいくこと。これがAIから独自の視点を引き出す唯一の方法だ。

一般論を却下する。逆張りを要求する。専門家の視点を求める。読者体験を言語化させる。これらを組み合わせ、満足するまで繰り返す。

鋭いコンテンツを作れるかどうかは、AIの性能ではなく、あなたのダメ出し力にかかっている。

AIをうまく使いこなす力は、副業やフリーランスの仕事にも直結する。もし「AIを活用しながら在宅で収入を得たい」と考えているなら、まずは手軽に始められる副業から試してみるのもいい選択肢だ。

\登録料・利用料はもちろん無料!/

コメント