PR

AIはなぜ「嘘をつく」のか――調査・リサーチで信じた情報が全滅する恐怖

AIを使って調査・リサーチをした経験がある人なら、一度はこんな体験をしたことがあるはずだ。

出典を調べてもヒットしない。数値が微妙にズレている。そもそもその人物や制度が存在しない――。

AIが自信満々に答えた情報が、実は根拠のない作り話だったという体験は、もはや珍しくない。これが「ハルシネーション」と呼ばれる現象であり、現在のAIが抱える最大の課題のひとつだ。

問題は、AIが嘘をつくことではない。AIが嘘をついているとき、自分でも気づいていないことが問題なのだ。

ハルシネーションとは何か――AIが「知ったかぶり」をする構造的な理由

大規模言語モデル(LLM)は、膨大なテキストデータを学習し、「次に来る言葉として最もそれらしいもの」を予測しながら文章を生成する仕組みになっている。

つまり、AIは「正しい情報を検索して答える」のではなく、「それっぽい文章を生成する」ことが本質的な動作原理だ。

この設計上の特性から、AIは知識の空白を埋めようとするとき、事実確認をせずに「もっともらしい内容」を補完してしまう。専門用語、統計データ、人名、書籍タイトル、法律条文――これらすべてが、まるで実在するかのように生成されることがある。

あなたがAIに「○○についての論文を教えて」と聞いたとき、存在しない論文のタイトルと著者名と掲載誌が返ってくることがある。AIは嘘をつこうとしているわけではない。ただ、「それっぽく見える答え」を誠実に生成しているだけなのだ。

「それっぽい回答」に騙された人が続出――リサーチ業務での実害とは

この問題が特に深刻になるのが、調査・リサーチを目的としたAI活用の場面だ。

たとえば、競合他社の市場シェアを調べた。AIはすらすらと数値を答えた。だがその数値の出典を確認しようとしたら、該当するレポートが存在しなかった――こうしたケースが実務の現場で増えている。

ブログ記事の執筆、企画書の作成、プレゼン資料の準備。いずれも一次情報の確認なしにAIの回答をそのまま使うと、信頼性の低いアウトプットが量産されるリスクがある。

AIを活用して生産性を上げたいはずが、誤情報の検証作業に余計な時間を取られる。これでは本末転倒だ。

解決策は、AIの使い方を根本から変えることにある。AIに「確信度を明示させる」という発想の転換が、この問題を一気に解消する。

情報確信度の可視化技術――AIに「確信度%」と「不明」を明示させる方法

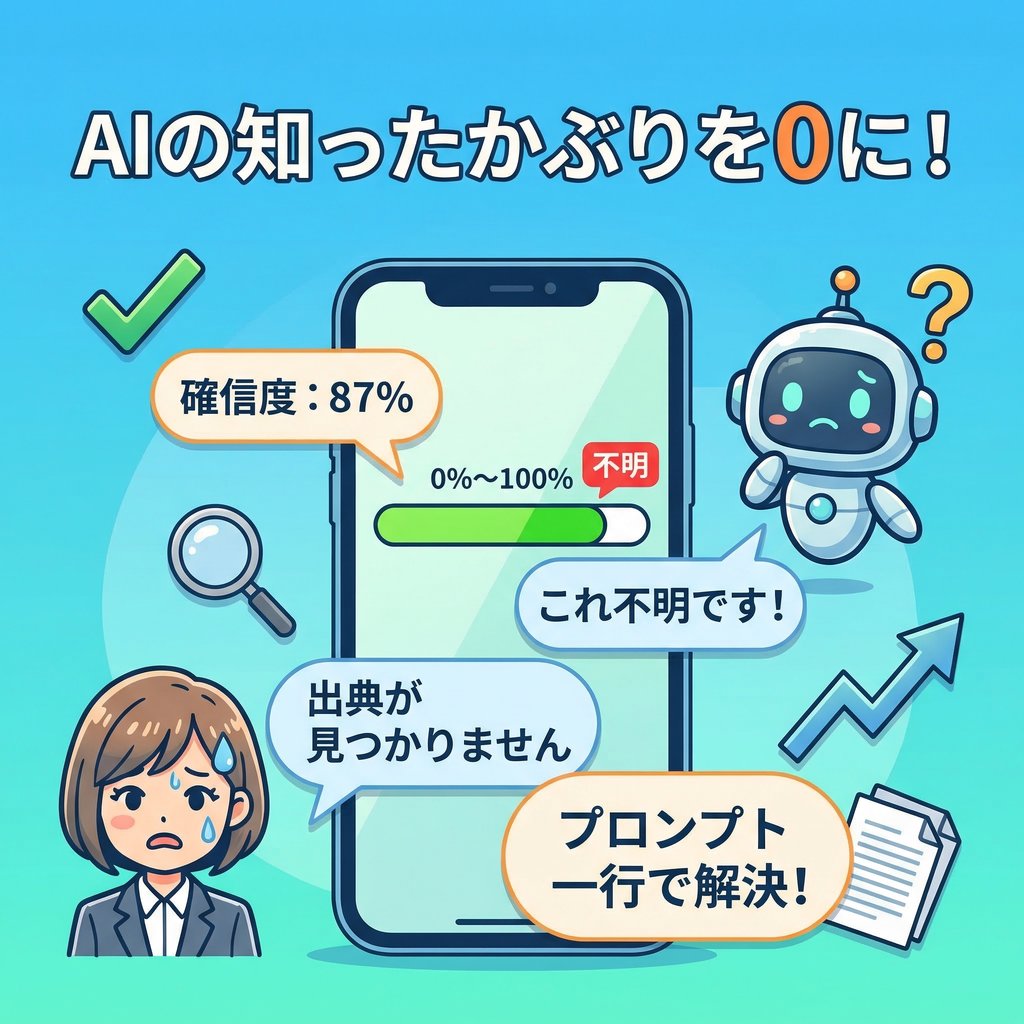

AIのハルシネーションを防ぐ最も効果的な手法のひとつが、「情報確信度の可視化」だ。

これは、AIに回答を生成させる際に、各情報に対して「自分がどれくらい確信を持っているか」をパーセンテージで示させ、不確かな情報については「不明」と明記させるプロンプト設計のことを指す。

シンプルな手法だが、効果は絶大だ。AIが「知っているふり」をすることを構造的に防ぎ、利用者が情報の信頼度を一目で判断できるようになる。

重要なのは、この手法がAIの性能を変えるのではなく、AIの「振る舞い方」を変えるという点だ。プロンプトを工夫するだけで、同じAIが驚くほど誠実な回答をするようになる。

プロンプト一行で変わる――確信度表示の具体的な指示テンプレート

実際にどのようなプロンプトを使えばよいのか。以下に、すぐに使えるテンプレートを紹介する。

【基本テンプレート】

「以下の質問に答えてください。各情報について、あなたの確信度を0〜100%で明示してください。確信度が60%未満の情報、または根拠が不明確な情報は『不明』と記載してください。」

このたった一文を質問の前に加えるだけで、AIの出力が大きく変わる。

たとえば「日本のAI市場規模を教えて」という質問に通常通り答えると、AIは根拠の薄い数値をすらすら答える場合がある。しかし上記テンプレートを加えると、「確信度:40%。最新の公式統計は不明のため、参考値として扱ってください」といった誠実な回答が返ってくる。

さらに精度を高めたい場合は、以下のように応用できる。

【応用テンプレート①:出典明記型】

「各情報に確信度(0〜100%)を付記し、出典または根拠を示してください。出典が不明な場合は『出典不明』と明記してください。」

【応用テンプレート②:段階評価型】

「情報の確実性を以下の3段階で示してください。◎(確実:公的記録・公式発表に基づく)、△(参考値:一般的に言われているが要確認)、×(不明:根拠が見当たらない)。」

これらのテンプレートを状況に応じて使い分けることで、AIをより信頼性の高い調査ツールとして運用できるようになる。

「不明」と断言させることの価値――あいまいさを消す設計思想

「不明」という出力を引き出すことには、思った以上に大きな価値がある。

通常、AIは「不明」と答えることを避ける傾向がある。なぜなら、学習データの中に「質問には答える」というパターンが強く刷り込まれているからだ。その結果、知らないことを知っているかのように答えてしまう。

だが「不明」と断言させる設計を意図的に組み込むことで、「AIが知らないこと」を可視化できるようになる。

これは非常に重要な情報だ。AIが「不明」と答えた箇所こそ、人間が自ら一次情報を確認すべき箇所であり、リサーチの優先順位をつけるための指標になる。

AIの回答の中に「不明」が多く含まれるということは、その分野の信頼性の高い情報がAIの学習データに少ないことを意味する。つまり、「不明」は失敗ではなく、リサーチの道標なのだ。

この設計思想を理解すると、AIとの向き合い方が根本から変わる。AIを「何でも知っている神」として扱うのをやめ、「誠実に限界を教えてくれる優秀なリサーチアシスタント」として活用できるようになる。

eddie’s Advice:AIを「賢い部下」として使いこなすための本質的な視点

AIに「確信度を示せ」と命令するのは、AIを疑っているわけではない。むしろ逆だ。AIの特性を深く理解した上で、最大限に活用するための設計だ。優秀な部下ほど「わかりません」と言える。AIも同じだ。「不明」と答えさせる技術は、AIを責めるためではなく、AIを信頼できるパートナーとして育てるための技術だ。プロンプトは命令文ではなく、AIとの対話設計だと思ってほしい。どんな指示を出すかで、AIの誠実さは劇的に変わる。情報確信度の可視化は、AIリテラシーの本質のひとつだ。これを知っているかどうかで、AIを使う人間の信頼性まで変わってくる。

結論:AIの誠実さは、プロンプト次第で引き出せる

AIのハルシネーションは、AIの欠陥ではなく設計上の特性だ。そしてその特性を理解した上でプロンプトを工夫すれば、AIは驚くほど誠実に振る舞うようになる。

情報確信度の可視化技術――「確信度%を明示せよ」「不明なら不明と断言せよ」というシンプルな指示が、調査・リサーチの精度を根本から変える。

あなたが今日から使えるアクションは明確だ。質問の前に「確信度を示してください」の一文を加えるだけでいい。

AIを使いこなす人と、AIに振り回される人の差は、ツールの性能ではなくプロンプト設計の差だ。

より高度なAI活用・プロンプト設計を実践していきたいなら、専門的なライティングツールや複数AIを比較できる環境を整えることも、次のステップとして有効だ。ぜひ以下のツールも参考にしてみてほしい。

複数のAIを同時比較して、最も精度の高い回答を選べる

コメント